Как обезопасить нас от искусственного интеллекта?

Идея того, что искусственный интеллект неизбежно приведет нас к сценарию, в котором машины восстают против людей, довольно популярна. Искусственный сверхинтеллект кажется величайшей из возможных угроз, а фантастические сюжеты, согласно которым мы будем не нужны в мире, принадлежащем технологиям, в популярности никогда не теряли.

Неужели это неизбежно?

Литературное и кинематографическое изображение разумных компьютерных систем из 60-х годов помогло сформировать и обобщить наши ожидания будущего, когда мы встанем на путь создания машинного интеллекта, превосходящего человеческий. ИИ, очевидно, уже превзошел человека в определенных специфических задачах, требующих сложных вычислений, но по-прежнему отстает в ряде других возможностей. Как одновременно увеличить мощь этого сурового инструмента и сохранить наше хозяйствующее положение над ним.

Поскольку искусственный интеллект уже играет и будет продолжать играть большую роль в нашем будущем, крайне важно исследовать наши возможности сосуществования с этими сложными технологиями.

Кевин Абош, основатель компании Kwikdesk, которая занимается обработкой данных и развитием искусственного интеллекта, поделился своими мыслями на этот счет. Он считает, что искусственный интеллект должен быть быстрым, незаметным, надежным, грамотным и этичным. Да, этичным.

Этические рамки

В концепции искусственной нейронной сети, созданной по подобию биологической нейронной сети, нет ничего нового. Единицы вычислительной мощи, которые называются нейронами, соединяются друг с другом и образуют сеть. Каждый нейрон применяет сложный алгоритм обучения на входе, прежде чем передать данные другим нейронам, пока не активируется нейрон на выходе и не откроет возможность для чтения. Экспертные системы полагаются на людей, которые будут «учить» систему, засеивая ее семенами знаний. Механизмы логической обработки ищут соответствия, делают выборы, устанавливают правила в стиле «если это, тогда то» по отношению к базе знаний. В этом процессе новые знания добавляются к базе знаний. Чистая нейронная сеть учится в процессе получения нелинейного опыта, не располагает проблемами засеивания знаний экспертом. Гибридные сети доказали, что улучшают возможности обучения машинами.

Теперь давайте рассмотрим этические проблемы таких систем. Далее от первого лица.

«Злой код» против доброго кода

Автор использует слова, чтобы погрузить читателя в вымышленный мир, и делает это по-разному, но великие авторы делают это очень изящно. Инженер-программист пишет строки кода, которые облегчают обработку и движение данных. Он тоже может выбирать из ряда вариантов разные способы, но изящные кодеры — фолкнеры компьютерных наук. Продвигающийся кодер сосредоточен на том, как заключить как можно больше и лучше в коротком и изящном коде. Лишний код сводится к минимуму. Великий код также удерживает открытое окно для последующих дополнений. Другие инженеры могут добавлять код с присущей им элегантностью, и продукт развивается без проблем.

В основе любого рукотворного продукта лежит намерение. Вещи, сделанные людьми, пропитаны намерениями, и в той или иной степени являются носителями самой природы создателя. Некоторым бывает сложно представить себе неодушевленный объект, обладающий такой природой. Но многие с этим согласятся. Энергия намерений существует тысячи лет, унифицирует, делит, объединяет, трансформирует социум. Нельзя недооценивать и силу языка. Не забывайте, что линии кода написаны определенным языком программирования. Таким образом, я убежден, что код, который становится программным обеспечением, используемым на компьютерах или мобильных устройствах, весьма «живой».

Не рассматривая мудрость и духовность в контексте информатики и потенциальных последствий искусственного интеллекта, мы все еще можем рассматривать статический код как единое целое с потенциалом «творить добро» или «творить зло». Эти выходы обретают себя только в процессе использования приложений людьми. Именно четкий выбор, который делают люди, влияет на природу приложения. Их можно рассматривать в локальной системе, определяя положительное или отрицательное влияние на эту систему, или же на основе набора заранее определенных стандартов. Тем не менее, как журналист не может быть на 100% беспристрастным в процессе написания статьи, так и инженер вольно или невольно добавляет природу своих намерений в код. Некоторые могут возразить, мол, написание кода — это логический процесс, и настоящая логика не оставляет пространства для природы.

Но я уверен, что в момент, когда вы создаете правило, блок кода или весь код, это все проникается элементом человеческой природы. С каждым дополнительным правилом углубляется проникновение пророды. Чем сложнее код, тем больше в нем этой природы. Отсюда рождается вопрос: «Может ли природа кода быть доброй или злой?».

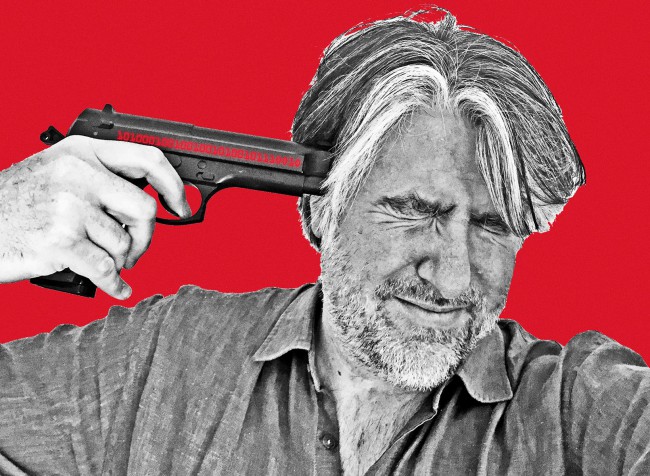

Очевидно, вирус, разработанный хакером, который злонамеренно пробивается сквозь защиту компьютера и сеет хаос в вашей жизни, пропитан злой природой. Но как насчет вируса, созданного «хорошими ребятами» с целью проникновения в компьютеры террористической организации ради предотвращения террористических актов? Какова его природа? Технически он может быть идентичен свому гнусному двойнику, просто используется для «хороших» целей. Так значит его природа добрая? В этом весь этический парадокс вредоносного программного обеспечения. Но мы не могли обойти стороной, размышляя о «злом» коде.

По моему мнению, существует код, который по своей сути тяготеет к «злу», и существует код, который по своей сути смещен в сторону доброжелательности. Это принимает более важное значение в контексте компьютеров, работающих в автономном режиме.

В Kwikdesk мы разрабатываем фреймворк ИИ и протокол, основанный на моей конструкции экспертной системы/гибрида нейронной сети, которая больше всего созданного на сегодняшний день напоминает биологическую модель. Нейроны проявляются в виде модулей ввода/вывода и виртуальных устройств (в определенном смысле автономных агентов), соединенных «аксонами», безопасными, разделенными каналами зашифрованных данных. Эти данные расшифровываются по мере входа в нейрон и после определенных процессов зашифровываются перед отправкой в следующий нейрон. Перед тем как нейроны смогут связаться друг с другом через аксон, должен произойти обмен ключами участника и канала.

Я считаю, что безопасность и разделение должны быть встроены в такие сети с самого низкого уровня. Надстройки отражают качества своих мельчайших компонентов, поэтому все, что меньше безопасных строительных блоков, приведет к небезопасной работе всей линии. По этой причине данные должны защищаться локально, а расшифровываться при локальной передаче.

Внедрение и гарантии

Качество нашей совместной жизни с машинами, которые становятся умнее и умнее, по понятным причинам вызывает обеспокоенность, и я абсолютно уверен, что мы должны принять меры, чтобы обеспечить здоровое будущее грядущим поколениям. Угрозы умных машин потенциально многообразны, но могут быть разбиты на следующие категории:

Резервирование. На рабочих местах людей будут заменять машины. Этот сдвиг происходит уже в течение многих десятилетий и будет только ускоряться. Необходимо соответствующее образование, чтобы подготовить людей к будущему, в котором сотни миллионов традиционных рабочих мест просто перестанут существовать. Это сложно.

Безопасность. Мы полагаемся на машины всецело и будем полагаться дальше. По мере того, как мы все больше доверяем машинам во время перехода из безопасной зоны в зону потенциальной опасности, мы можем столкнуться с риском машинной ошибки или вредоносного кода. Подумайте, например, о транспорте.

Здоровье. Персональные диагностические устройства и сетевые медицинские данные. ИИ будет продолжать развиваться в области превентивной медицины и анализа краудсорсных генетических данных. Опять же, мы должны иметь гарантии, что эти машины не будут вести вредоносную подрывную деятельность и никак не смогут нам навредить.

Судьба. ИИ с нарастающей точностью предсказывает, куда вы пойдете и что будете делать. По мере развития этой сферы, он будет знать, какие решения мы принимаем, куда пойдем на следующей неделе, какие продукты будем покупать или даже когда мы умрем. Хотим ли мы, чтобы другие имели доступ к этим данным?

Знания. Машины де-факто накапливают знания. Но если они будут приобретать знания быстрее, чем люди смогут их проверять, как мы сможем доверять их целостности?

В заключение хочу отметить, что бдительный и ответственный подход к ИИ для смягчения потенциальных неприятностей в технологическом взрыве сверхновой — наш путь. Мы либо укротим потенциал ИИ и будем молиться, чтобы он приносил человечеству только лучшее, либо сгорим в его потенциале, который будет отражать худшее в нас.